文章目录

从科学研究到商业应用领域,眼动跟踪技术都受到普遍关注。本文主要从眼动跟踪技术的发展过程、应用领域、理论基础、研究方法及发展前景等方面展开了论述。通过调研认为,眼动跟踪技术对计算机硬件软件的实时性和准确性有极高的要求。由于近几年深度学习的发展,眼动跟踪技术在处理复杂问题的能力上得到了大幅度提高,在大规模商业应用具有延展性及实用性。

关键字:眼动跟踪技术;人机交互;多通道;神经网络;虚拟现实

引言

随着计算机硬件与软件技术的快速发展,多通道人机交互(multi-modal human-computer interaction, MMHCI) 成为国内外人机交互软件工程方法中非常热门的领域。由于多通道人机交互更符合人的心理与生理习惯,它被认为是更为自然的人机交互方式[1]。

与传统的WIMP/GUI等单一通道交互方式不同的是,多通道人机交互方式可以从多个通道获取信息,并通过多通道信息的融合来处理信息并生成对用户的反馈。这些通道包括语音识别、人脸识别、情感理解、手势理解、姿态分析、笔、触觉等[2]。同时,通道之间可以相互补充,克服彼此的缺陷,具有更强大的表达能力、自然性、灵活性和便携性,人机交互方式向人与人交互方式靠拢。通过人工智能与机器学习的技术对这些输入的信息进行分析,计算机才能有效地捕捉用户的意图,提高人机交互的自然性和高效性。多通道用户界面研究,它代表了人机交互的一种新范式。

而眼睛是心灵的窗口,透过这个窗口我们可以探究人的许多心理活动的规律。人类的信息加工在很大程度上依赖于视觉,来自外界的信息约有80%~90%是通过人的眼睛获得的[3],通过对人眼注视点的跟踪可以获得人类的视觉感知信息。因此,对于“人是如何看事物”的科学研究一直没有间断过。关于这一点,对于眼动跟踪的研究被认为是视觉信息加工研究中最有效的手段。

定义

眼动追踪是一项科学应用技术,用户无需与交互设备物理接触即可发送信息与接收反馈。从原理上看,眼动追踪主要是研究眼球运动信息的获取、建模和模拟,用途颇广。而获取眼球运动信息的设备除了红外设备之外,还可以是图像采集设备,甚至一般电脑或手机上的摄像头,其在软件的支持下也可以实现眼球跟踪[4]。

发展过程

眼动跟踪的概念最早产生于20世纪30年代,最初的设计目的是出于商业考虑,但当时由于传感器技术和信息处理器计算速度的限制,眼跟踪技术在发展中遇到许多困难,发展十分缓慢[4]。

随着眼跟踪技术的日趋成熟,眼动仪的应用也越来越广泛。国外在20世纪初就已经开始研制眼动仪,到现在眼动技术已经发展得比较完善,很多公司已将眼动仪开发成成品。根据英国Derby大学行为科学研究所的David Woodillg教授建立的眼动仪数据库网站公布的结果,目前世界上约有44家生产眼动仪的厂家。根据角膜和瞳孔的反光原理设计的眼动仪有:美国应用科学实验室(ASL)生产的504型和501型眼动仪、加拿大SR公司生产的eyelink II型头盔式眼动仪、法国的Me Division公司生产的Mon VOGl型和Mon VOG2型眼动仪等。

医学上,美国的威视VISX STAR S3准分子激光系统是一种三维自动眼球追踪系统,该系统随眼球运动自动将激光调整到切削点,对眼睛疾病进行快速安全的治疗;此外,还可以通过记录眼球活动去检查患者的脑平稳系统功能,着重观察精神分裂、躁狂抑郁症、焦虑症、强迫症病人的平稳眼跟踪(SEEM)和观察图形时的探索性眼球活动(SEMVF)。

近年来,光学传感器技术的发展和计算机信息处理能力的提高,计算机能够实时处理复杂的图像信息。同时CCD技术从线阵到面阵得到了飞速发展,从而使得眼跟踪技术也相应得到快速发展,有关视觉一眼动系统的研究也越来越多,NASA、哈佛、麻省、剑桥、牛津等著名科研机构或大学都设有专门的视觉眼动系统研究部门。深度学习的加入也为眼动跟踪技术的发展注入了新的活力。

当前应用

眼动跟踪在民用方面主要用于医学、界面设计与评估、产品测试(广告测试、网页测试、产品可用性测试等)、场景研究(商场购物、店铺装潢、家居环境等)、动态分析(航空航天相关领域、体育运动、汽车、飞机驾驶、打字动作分析等)和人机交互等各种领域,另外在理解人的意图的智能计算机、具有交互功能的家用电器、虚拟现实和游戏等领域也有很好的应用前景。

界面设计

在界面设计方面,可以通过分析用户的视线扫描路径来揭示人与计算机交互过程中人的信息加工的一些内在机制,用眼动测试所取得的量化指标来建立原型测试模型,从而使界面的概念模型与人的心理模型相吻合。在界面评估方面,可通过采集眼动时空特性的相关数据,分析其数据得出一些重要的眼动参数,从而为优化界面设计提供基础。

产品测试

在产品测试方面,以广告测试为例,主要是利用眼动仪考察人们在观看广告时的一些眼动特征,如顾客注视广告画面的先后顺序,对广告任何一部分注视的时间、注视次数、眼跳、瞳孔直径变化情况等等,然后通过与记忆测试相结合的方法来进行广告效果测试。

功效学

在工效学方面,现代人机系统,特别是航空航天驾驶中,作业人员是在特定环境中操作和管理复杂系统和机械设备的,当人在这种环境中工作时,既要靠眼睛来观察环境,又要靠细致的注视来完成精确的控制动作。利用眼动仪系统,通过分析眼睛的运动就可知人在操作时如何分配注意力,同时了解仪表、屏幕以及外视景如何设计和合理分配才能获得最好的人机交互,既减轻操作人员的工作负担又避免出错,切实提高人机工效。此外,Eriksson通过跟踪、定位与识别眼睛状态来获取疲劳状态,Grace结合眼睑闭合度方法开发了一套用于重型卡车司机的瞌睡监测系统,Singh与Zheng则利用面部识别技术进行疲劳检测等。

人机交互

人机交互方面,人与计算机交互的目的在于利用所有可能的信息通道进行人机交流,提高交互的自然性和高效性。视觉输入法即为在对视线完全实时跟踪的同时,利用视线对计算机进行操作,用于帮助只能控制眼睛肌肉的重度残废者进行控制、通信、娱乐等。佳能照相机的新机型(EOS2E)增加了一种眼控对焦的新功能,可以在一幅画面中根据人的注视位置进行聚焦,而这种功能正是在照相机上添加一维眼动测量装置来实现的。类似的,还有一些系统允许用户利用眼睛控制鼠标进行画画等。

航空与军事

在航空军事方面,随着现代战争对高科技的强烈需求,头盔显示器和头盔瞄准具(HMD/HMS)作为一种重要机载显示设备,其地位和作用也越来越突出。跚D/蹦S正在越来越广泛地应用于一些新型战机,用于视野范围内目标的跟踪。由于眼睛的转动即迅速灵活又不受生理因素的限制,在视野范围内只要看到目标就可以使战机捕捉到目标,在格斗中可以赢得宝贵的时间,增加获胜的机会。因此,如果能够利用眼睛不受影响、可以灵活转动的特性并实时地测定眼睛瞄准线的方向,使战机更加快捷地跟踪目标、锁定目标和对目标进行攻击,则可以大大提高战机攻击的灵敏度和准确度,从而使战机的作战能力和生存能力得到极大的提高。20世纪80年代美国空军的虚拟座舱计划,就是通过许多不同的信息源在飞行员周围形成一个“虚拟世界”,眼跟踪技术作为头盔瞄准具的一种补充被列为该项计划中的一项技术。1994年该项技术被美国空军作为军事机密技术开始应用于一些新型战机,如F-16、YF-23、F-22、F-104、F/A-18、F-111等。

总之,从科学研究到商业应用,眼球追踪在许多领域都是一个重要的工具。尽管眼动追踪的应用范围很广,但它尚未成为一项普及技术。在最新的研究领域[5,6,8],有研究者通过在移动电话和平板电脑等商用硬件上开发眼动跟踪软件,无需额外的传感器或设备,就可以让每个人的手掌都拥有眼动跟踪的能力。

主要研究方法分类

眼动跟踪技术主要的实现手段可以分为以硬件为基础和以软件为基础两类。以硬件为基础的跟踪技术中,视线跟踪装置有强迫式(intrusiveness)和非强迫式(no-intrusiveness)、穿戴式与非穿戴式[9]、接触镜与非接触镜之分;其精度从0.1度至l度或2度不等,制造成本也有巨大差异。这种方法需要用户戴上特制的头盔、特殊的隐形眼镜,或者使用头部固定架、置于用户头顶的摄像机等,这种方式识别精度高,但对用户的干扰很大。而眼动跟踪精度与对用户的限制和干扰是一对难以调和的矛盾。

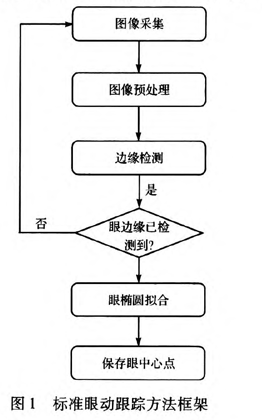

为了克服眼动跟踪装置对人的干扰,近年来人们提出了以软件为主实现对用户无干扰的眼动跟踪方法,其基本工作原理是先利用摄像机获取人眼或脸部图像,然后用图像处理算法实现图像中人脸和人眼的检测、定位与跟踪,从而估算用户的注视位置(计算机视觉)。图像处理的标准眼动跟踪方法框架如图1所示。

在通过视屏摄像头采集用户眼睛图像后,需对图像进行滤波、二值化等图像预处理[12],为后续眼动跟踪提供基础。除此以外也有很多学者利用神经网络的方法来处理图像信息获得准确地眼动跟踪的反馈。

最后,在眼跟踪技术发展过程中,许多科学家不断地研究、探索,创造性地提出了些跟踪眼睛运动的方法。从一开始的直接观察法、机械记录法到后来的电磁感应法、电流记录法及接触镜法、角膜反射跟踪法、双普金野法、虹膜一巩膜边缘跟踪技术、瞳孔一角膜跟踪法等。其具体原理如下:

(1)电磁感应法:将被试的眼睛麻醉,把一个装有探察线圈的隐形镜片吸附在眼睛上。线圈中存在感应电压,通过对感应电压的相敏检测,可以精确地测量水平和垂直方向的眼动。这种方法精确度高,但是接触眼球会引起受试者的不适。

(2)电流记录法:眼球运动可以产生生物电现象。角膜和视网膜的新陈代谢是不一样的,角膜部位的代谢率较小,网膜部位的代谢率较大,所以角膜和网膜之间就形成了电位差,角膜带正电,网膜带负电。当眼睛注视前方未发生眼动时,可以记录到稳定的基准电位, 当眼睛在水平方向上运动时,眼睛左侧和右侧的皮肤之间的电位差会发生变化, 而当眼睛在垂直方向上运动时,眼睛上侧和下侧的电位差会发生变化。将两对氯化银皮肤表面电极分别置于眼睛左右、上下两侧,就能引起眼球变化方向上的微弱电信号,经放大后得到眼球运动的位置信息。这种方法的特点是高宽带、低精度、对人干扰大。

(3)接触镜法:首先将一个小镜子附着在被试眼睛上,光线射向镜子,被反射的光线随着眼球的运动而变化,从而获得眼动信号。其技术特点是精度最高、高带宽、对人干扰大,使人有不舒适的感觉。

(4)角膜反射跟踪法:因为角膜是从眼球体的表面凸出来的,所以在眼球运动过程中,角膜对来自固定光源的光的反射角度也是变化的,因此可以在人眼前方放置一个近红外LED光源,和一个固定在受试者头部正前方的相机,角膜反射的光线通过眼睛前面的光束分离设备和一些反射镜、透镜传输到相机。同样的装置设于另一只眼睛前方。角膜反射光线的位置通过固定在头前方的摄像机屏幕上的图像及相应的一些算法来确定。该系统最大的误差主要是头部光学系统的滑动和由于眼睛与照相机镜头之间的距离而引起的误差。

(5)双普金野法:普金野图像是由眼睛的若干光学界面反射所形成的图像。角膜所反射出来的图像是第一普金野图像,从角膜后表面反射出来的图像微弱些,称为第二普金野图像,从晶状体前表面反射出来的图像称为第三普金野图像,由晶状体后表面反射出来的图像称为第四普金野图像。通过对两个普金野图像的测量可以确定眼注视位置。其技术特点是高精度、高带宽、对人干扰大。

(6)虹膜、巩膜边缘跟踪技术:用不可见的红外光照射眼部,在眼部附近安装两只红外光敏管,是虹膜与巩膜的边缘处的左右两部分反射的红外光分别为这两只光敏管所接受。当眼球向右运动时,虹膜转向右边,右边的光敏管所接受的红外线就会减少;而左边的巩膜反射部分增加,导致左边的光敏管所接受的红外线增加。利用这个差分信号就能无接触的测出眼动。其缺点是误差大,垂直精度低。

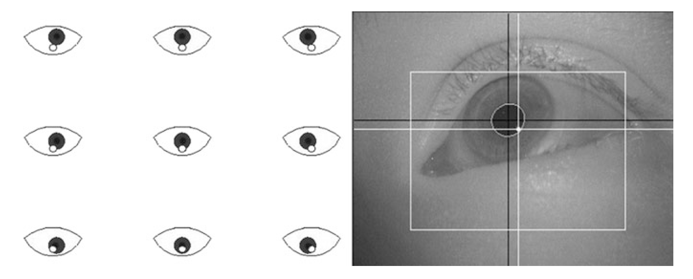

(7)瞳孔、角膜跟踪法:系统光学元件在空间固定,相对受试者的眼睛有较为固定的距离,并将反射的图像用摄像机记录下来,将摄像机获得的数据通过计算机或微处理器处理,辨别瞳孔和CR(角膜),然后把角膜反射点数据作为眼摄像机和眼球的相对位置的基点,根据瞳孔中心位置坐标计算出在屏幕空间中的凝视点。这种方法准确、头具误差小且对人无干扰[7,10]。基于Hough变换圆检测法需要在参数空间内对3个参数圆心、半径等进行搜索。首先用积分投影法检测到眼睛瞳孔的大致位置,然后用边缘检测算子提取图像边缘信息,并将边缘图像二值化,然后再利用基于圆的Hough变换快速定位出人眼。

图2:瞳孔中心和角膜反射的关系

局限性与发展前景

人机交互中眼动跟踪技术的局限性

由于眼动跟踪技术还不成熟,不同的眼动跟踪技术有其各自的优缺点,例如采样率、精确度及干扰性等,因此目前将其应用于人机交互中还存在着一定的局限性,主要有精度与自由度的问题、“米达斯接触”问题[15]以及算法问题。

首先是精度与自由度的问题。以硬件为基础的视线跟踪技术与以软件为基础的视线跟踪技术相比,其精度较高,但由于使用的设备限制了人的自由度,所以对人有较大的干扰,使用起来不是很方便;以软件为基础的视线跟踪技术,虽然降低了对用户的限制,但其精度相对而言低得多,要想得到准确的注视焦点比较困难。精度与自由度目前是一对尖锐的矛盾。

其次是“米达斯接触”问题。用户视线的移动往往是随意的,并不总有一定的意义,移动视线不代表就要发出一条计算机命令。因此如果屏幕上的计算机鼠标指针总是随着用户的视线移动,很可能会引起用户的厌烦。如果能够在用户希望发出控制时,界面及时的处理用户的视线输入,而相反时则忽略视线的移动,则可以很好的解决这个问题。遗憾的是,一般无法区分这两种情况[5,7]。

再次是算法问题。眼动中的抖动、眨眼易造成数据中断,这种干扰信号,使得获取注视焦点的屏幕投影以及眼动数据都存在一定的困难。对于第一个问题,可以把离注视点最近的屏幕对象作为用户感兴趣的对象,但由于注视点本身的精度较低,当屏幕元素离得较近时则难以判断;对于后一个问题,目前是尝试使用眼动的某种先验模型来加以弥补。但是目前还没有能够把视觉通道与其它通道整合,实现无缝连接的成熟、高效的融合方法。文中对于眨眼的情况,在瞳孔轮廓特征点的探测部分予以考虑,利用设置门限的方法进行判别,一旦超过门限值,便认为产生了数据中断,则开始下一帧图像的处理。

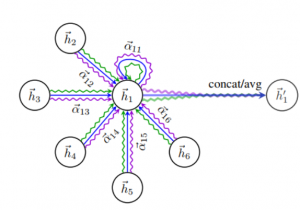

基于神经网络的眼动跟踪技术发展前景

近年来,由于深度学习的发展,基于神经网络的眼动跟踪技术也有了发展[6,11]。有研究表明高效的眼动跟踪软件可以可靠地工作在智能手机和平板电脑等移动设备,而不需要任何外部附件(图3)。使用移动设备进行眼动追踪技术能提供许多好处:(1)广泛使用更多的超过三分之一的世界人口估计智能手机在2019年,远远超过台式机或笔记本用户的数量;(2)技术升级的采用率高——很大一部分人拥有最新的硬件,可以实时使用计算成本高昂的方法,如卷积神经网络(CNNs);(3)移动设备上相机的大量使用导致相机技术的快速发展和部署,(4)相机相对于屏幕的固定位置减少了未知参数的数量。

![]()

图3:移动设备的眼动追踪技术

视点估计又被分为基于模型的或者基于外观的,基于模型的方法根据几何模型又被分为基于角膜反射和基于形状的方法,角膜反射的方法通过外部光源检测眼睛特征,基于形状的通过眼睛的方法shape推测出视点方向(例如瞳孔中心或者虹膜边缘)。该论文中,作者的眼动追踪CNN。输入包括左眼,右眼,脸的原始帧图像检测。输出是距离相机的距离,单位是厘米。

![]()

图4:iTracker 卷积神经网络模型

此种卷积神经网络的模型学习的特性概括了现有的数据集,相比于大多数方法有很大的优势,其误差可以降到1.7至2.0cm左右,具有很大的潜力。表1给出了具体结果。

表1 无约束的眼睛跟踪结果

![]()

基于眼动跟踪的虚拟现实技术

虚拟现实技术是利用计算机生成一种模拟环境(如飞机驾驶舱、操作现场等),通过多种传感设备使用户“投入”到该环境中.实现用户与该环境直接进行自然交互的技术,是一种可以创建和体验虚拟环境的计算机系统技术[13]。

为了创造更加沉浸的体验,VR头显公司正在大举向眼动追踪技术投资。事实上,从某种意义上讲,眼动追踪技术可以看成是VR技术的补充[14]。在VR中,眼动追踪技术未来应多用于后台工作,可能包括以下领域:

(1)图形渲染资源分配(Graphics rendering resource allocation):当人注视某处时,更多的图形渲染资源能分配到这个方向。这样能增强渲染力,从而提高输出质量。

(2)数据预取(Data prefetch):VR数据处理一般需要一定时间才能完成,如在线上数据库查找数据等。如果用户要扫视某一个方向,在用户选择物品前,数据预取便能在后台开始。这样可改善VR环境的感知反应,对移动数据网络上尤为有用。

(3)多模式智能3D物体选择(Multimodal smart 3-D object selection):在一个杂乱的VR环境里指向一个小物件并不容易,而眼动追踪技术能通过结合眼动信息与控制器,使物体更具体更清楚,这样用户便能准确地选取物件。

(4)自动头显校准(Automatic headset calibration):通过确定用户眼球的位置,头显能更好地调整画面参数,提供用户最佳的舒适度。

(5)平衡操纵(Balance manipulation):前庭眼反射是眼部动作和前庭系统之间的神经反射。如果通过加速度计获得眼睛运动和头显运动的信息,就可以对用户前庭系统的可能状态进行判断。由此可进行系统性操作,增强平衡感,减少VR使用期间晕动症的影响。

综述结论

眼动跟踪技术的研究被认为是视觉信息加工研究中最有效的手段,吸引了心理学、工效学、计算机科学及运动学等领域的普遍关注,其研究成果在工业、商业及军事等领域得到广泛应用。虽然眼动跟踪已经存在了几个世纪,我们相信,这项工作将成为下一代的人机交互眼动跟踪的关键基准的解决方案,并服务于大多数人。

参考文献

[1] 崔鸿雁. 多通道用户界面[J]. 微处理机, 2006, 27(5):71-73.

[2] 普建涛, 秦镜. 多通道用户界面研究[J]. 计算机应用, 2001, 21(5):4-6.

[3] 武媛媛. 眼动跟踪技术研究[D]. 西安电子科技大学, 2009.

[4] 刘涛. 眼动跟踪技术的研究及优化实现[D]. 西安电子科技大学, 2011.

[5] 程时伟, 陆煜华, 蔡红刚. 移动设备眼动跟踪技术[J]. 浙江大学学报(工学版), 2016, 50(6):1160-1166.

[6] Krafka K, Khosla A, Kellnhofer P, et al. Eye tracking for everyone[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2016: 2176-2184.

[7] 杨庆华, 张达磊, 荀一,等. 面向人机交互的眼动跟踪方法研究[J]. 机电工程, 2016, 33(7):904-908.

[8] Kassner M, Patera W, Bulling A. Pupil: an open source platform for pervasive eye tracking and mobile gaze-based interaction[C]//Proceedings of the 2014 ACM international joint conference on pervasive and ubiquitous computing: Adjunct publication. ACM, 2014: 1151-1160.

[9] Ernst J, Genc Y. Geometric calibration of head-worn multi-camera eye tracking system: U.S. Patent 8,957,948[P]. 2015-2-17.

[10] Mestre C, Gautier J, Pujol J. Robust eye tracking based on multiple corneal reflections for clinical applications[J]. Journal of biomedical optics, 2018, 23(3): 035001.

[11] Hansen D W. Eye gaze tracking: U.S. Patent 9,398,848[P]. 2016-7-26.

[12] 刘青, 薛澄岐, Falk Hoehn. 基于眼动跟踪技术的界面可用性评估[J]. 东南大学学报(自然科学版), 2010, 40(2):331-334.

[13] Lévy P, Bononno R. Becoming virtual: Reality in the digital age[M]. Da Capo Press, Incorporated, 1998.

[14] Larsen E, Umminger F, Ye X, et al. Methods and systems for user interaction within virtual reality scene using head mounted display: U.S. Patent Application 10/073,516[P]. 2018-9-11.

[15] Haans A, Ijsselsteijn W A. The Virtual Midas Touch: Helping Behavior After a Mediated Social Touch[J]. IEEE Transactions on Haptics, 2009, 2(3):136-140.